트랜스포머와 셀프 어텐션: 현대 NLP의 핵심 기술

F-Lab : 상위 1% 개발자들의 멘토링

AI가 제공하는 얕고 넓은 지식을 위한 짤막한 글입니다!

트랜스포머와 셀프 어텐션의 중요성

트랜스포머는 현대 자연어 처리(NLP)에서 가장 중요한 모델 중 하나로 자리 잡았습니다. 특히 셀프 어텐션(Self-Attention) 메커니즘은 트랜스포머의 핵심 구성 요소로, 입력 시퀀스 내의 토큰 간 관계를 계산하여 문맥을 이해하는 데 중요한 역할을 합니다.

왜냐하면 기존의 RNN 기반 모델은 순차적으로 데이터를 처리해야 했기 때문에 병렬 처리가 불가능하고, 긴 시퀀스에서 앞쪽 정보가 뒤로 갈수록 희미해지는 문제가 있었기 때문입니다.

트랜스포머는 이러한 문제를 해결하기 위해 병렬 연산이 가능한 구조와 포지셔널 인코딩(Position Encoding)을 도입했습니다. 이를 통해 긴 시퀀스에서도 문맥 정보를 효과적으로 유지할 수 있습니다.

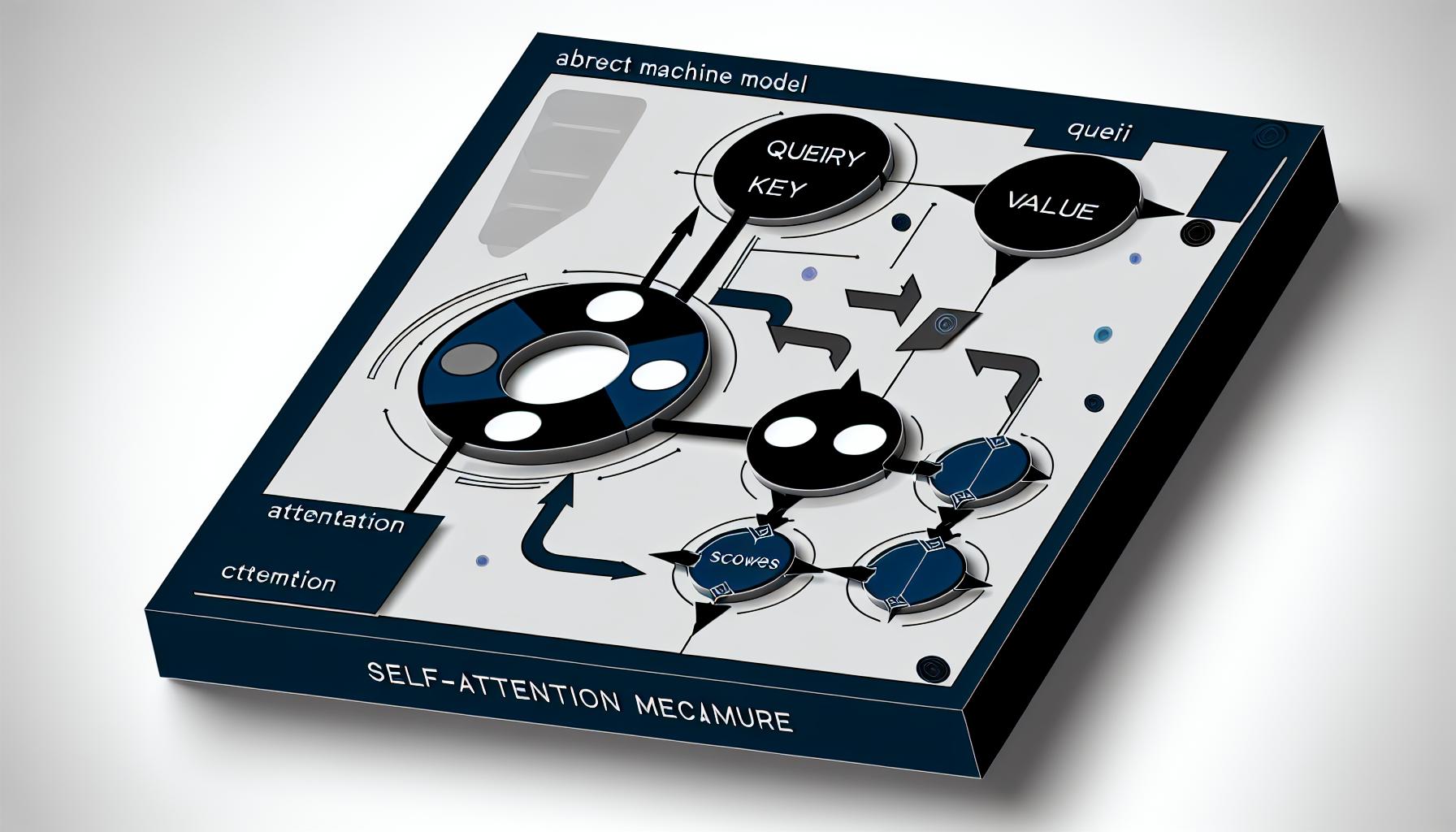

셀프 어텐션은 입력 시퀀스의 각 토큰을 쿼리(Query), 키(Key), 밸류(Value)로 변환하여 어텐션 스코어를 계산합니다. 이 스코어는 토큰 간의 관계를 가중치로 표현하며, 이를 통해 모델은 문맥을 더 깊이 이해할 수 있습니다.

이 글에서는 트랜스포머와 셀프 어텐션의 작동 원리, 그리고 이를 활용한 NLP 모델의 발전 과정을 자세히 살펴보겠습니다.

셀프 어텐션 메커니즘의 작동 원리

셀프 어텐션은 입력 시퀀스의 각 토큰을 쿼리, 키, 밸류로 변환하여 어텐션 스코어를 계산합니다. 이 스코어는 토큰 간의 관계를 나타내며, 이를 기반으로 각 토큰의 중요도를 가중치로 표현합니다.

왜냐하면 기존의 어텐션 방식은 디코딩 단계에서 인코더의 출력만을 참조했지만, 셀프 어텐션은 입력 시퀀스 자체의 문맥을 더 깊이 이해할 수 있도록 설계되었기 때문입니다.

예를 들어, "The cat sat on the mat"이라는 문장에서 "cat"과 "mat" 간의 관계를 이해하려면, 셀프 어텐션은 이 두 단어 간의 어텐션 스코어를 계산하여 문맥을 파악합니다.

셀프 어텐션의 계산 과정은 다음과 같습니다:

Query = Wq * Input

Key = Wk * Input

Value = Wv * Input

Attention Score = softmax(Query * Key^T / sqrt(d_k))

Output = Attention Score * Value

이 과정에서 멀티헤드 어텐션(Multi-Head Attention)을 사용하여 다양한 관점에서 문맥을 이해할 수 있습니다.

트랜스포머의 구조와 병렬 처리

트랜스포머는 인코더-디코더 구조를 기반으로 하며, 각 레이어는 셀프 어텐션과 피드포워드 네트워크로 구성됩니다. 이 구조는 병렬 처리가 가능하여 기존 RNN 기반 모델보다 훨씬 빠른 연산 속도를 제공합니다.

왜냐하면 트랜스포머는 모든 토큰 정보를 한 번에 처리할 수 있는 병렬 연산 구조를 채택했기 때문입니다. 반면, RNN은 순차적으로 데이터를 처리해야 하므로 연산 속도가 느립니다.

트랜스포머의 인코더는 입력 시퀀스를 처리하여 문맥 정보를 포함한 표현을 생성합니다. 디코더는 이 표현을 기반으로 출력 시퀀스를 생성합니다.

포지셔널 인코딩(Position Encoding)은 입력 시퀀스의 순서를 나타내는 정보를 추가하여 모델이 순서를 인식할 수 있도록 합니다. 이는 트랜스포머가 순차적 구조 없이도 문맥을 이해할 수 있게 합니다.

이러한 구조는 번역, 요약, 질의응답 등 다양한 NLP 작업에서 높은 성능을 발휘합니다.

트랜스포머와 기존 모델의 차이점

트랜스포머는 기존의 RNN 및 LSTM 기반 모델과 비교하여 여러 가지 장점을 제공합니다. 가장 큰 차이점은 병렬 처리와 문맥 이해 능력입니다.

왜냐하면 RNN 기반 모델은 순차적으로 데이터를 처리해야 하므로 긴 시퀀스에서 앞쪽 정보가 희미해지는 문제가 있었기 때문입니다. 반면, 트랜스포머는 셀프 어텐션을 통해 모든 토큰 간의 관계를 한 번에 계산할 수 있습니다.

또한, 트랜스포머는 포지셔널 인코딩을 통해 순서 정보를 유지하며, 병렬 연산을 통해 연산 속도를 크게 향상시켰습니다.

예를 들어, 번역 작업에서 RNN 기반 모델은 긴 문장에서 앞쪽 단어의 정보를 잃어버릴 수 있지만, 트랜스포머는 셀프 어텐션을 통해 모든 단어 간의 관계를 유지합니다.

이러한 차이점은 트랜스포머가 NLP 작업에서 높은 성능을 발휘하는 이유 중 하나입니다.

트랜스포머의 한계와 미래

트랜스포머는 많은 장점을 가지고 있지만, 몇 가지 한계도 존재합니다. 예를 들어, 모델 크기가 크고 연산량이 많아 학습 및 추론에 많은 자원이 필요합니다.

왜냐하면 트랜스포머는 모든 토큰 간의 관계를 계산하기 위해 O(n^2)의 연산 복잡도를 가지기 때문입니다. 이는 긴 시퀀스를 처리할 때 문제가 될 수 있습니다.

이를 해결하기 위해 다양한 변형 모델이 제안되었습니다. 예를 들어, Longformer와 같은 모델은 긴 시퀀스를 효율적으로 처리하기 위해 희소 어텐션(Sparse Attention)을 도입했습니다.

또한, 트랜스포머는 NLP 외에도 이미지 처리, 음성 인식 등 다양한 분야에서 활용되고 있습니다. 이는 트랜스포머의 구조가 범용적이고 확장 가능하기 때문입니다.

미래에는 트랜스포머의 효율성을 개선하고, 더 다양한 작업에 적용할 수 있는 연구가 계속될 것입니다.

결론: 트랜스포머의 혁신과 가능성

트랜스포머는 NLP의 패러다임을 바꾼 혁신적인 모델입니다. 셀프 어텐션을 통해 문맥을 깊이 이해하고, 병렬 연산을 통해 연산 속도를 크게 향상시켰습니다.

왜냐하면 기존의 RNN 기반 모델이 가지던 한계를 극복하고, 더 높은 성능과 효율성을 제공했기 때문입니다.

트랜스포머는 번역, 요약, 질의응답 등 다양한 NLP 작업에서 높은 성능을 발휘하며, 이미지 처리, 음성 인식 등 다른 분야에서도 활용되고 있습니다.

앞으로도 트랜스포머와 관련된 연구는 계속될 것이며, 더 효율적이고 강력한 모델이 등장할 것입니다. 이는 AI와 머신러닝의 발전에 큰 기여를 할 것입니다.

트랜스포머와 셀프 어텐션에 대한 이해는 현대 NLP를 배우고 활용하는 데 필수적입니다. 이를 통해 더 나은 모델을 설계하고, 다양한 문제를 해결할 수 있을 것입니다.

이 컨텐츠는 F-Lab의 고유 자산으로 상업적인 목적의 복사 및 배포를 금합니다.